前言

spark 是 berkeley 开发的分布式计算的框架,相对于 hadoop 来说,spark 可以缓存中间结果到内存而提高某些需要迭代的计算场景的效率,目前收到广泛关注。下面来一起看看使用docker快速搭建spark集群的方法教程。

适用人群

准备工作

- 安装docker

- (可选)下载java和spark with hadoop

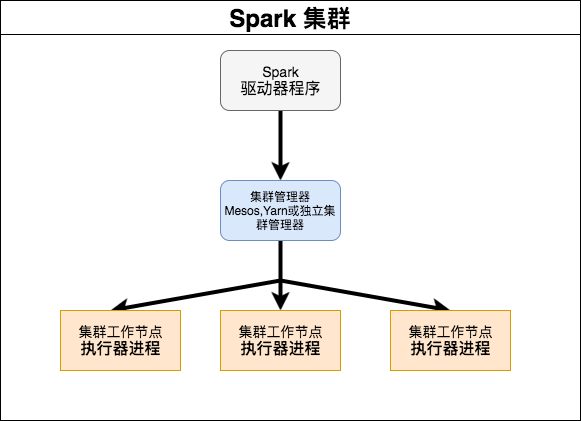

spark运行时架构图

- 集群管理器(mesos, yarn或者standalone mode)

- 工作节点(worker)

如何docker化(本例使用standalone模式)

base(基础镜像)

master(主节点镜像)

worker(工作镜像)

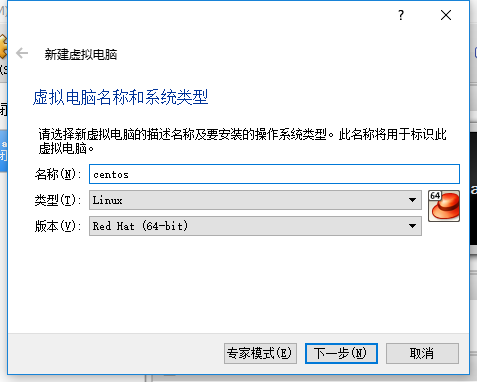

2、编写base dockerfile

注: 为方便切换版本基础镜像选择的是centos, 所以要下载java和spark, 方便调试, 可以下载好安装文件后本地搭建一个静态文件服务器, 使用node.js 的http-server可以快速搞定

命令如下

?

|

1

2 |

npm install http-server -g

http-server -p 54321 ~/downloads |

正式开始写dockerfile

?

|

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

22

23

24

25

26

27

28

29 |

from centos:7

maintainer ravenzz <raven.zhu@outlook.com>

# 安装系统工具

run yum update -y

run yum upgrade -y

run yum install -y byobu curl htop man unzip nano wget

run yum clean all

# 安装 java

env jdk_version 8u11

env jdk_build_version b12

# 如果网速快,可以直接从源站下载

#run curl -lo "http://download.oracle.com/otn-pub/java/jdk/$jdk_version-$jdk_build_version/jdk-$jdk_version-linux-x64.rpm" -h 'cookie: oraclelicense=accept-securebackup-cookie' && rpm -i jdk-$jdk_version-linux-x64.rpm; rm -f jdk-$jdk_version-linux-x64.rpm;

run curl -lo "http://192.168.199.102:54321/jdk-8u11-linux-x64.rpm" && rpm -i jdk-$jdk_version-linux-x64.rpm; rm -f jdk-$jdk_version-linux-x64.rpm;

env java_home /usr/java/default

run yum remove curl; yum clean all

workdir spark

run \\

curl -lo 'http://192.168.199.102:54321/spark-2.1.0-bin-hadoop2.7.tgz' && \\

tar zxf spark-2.1.0-bin-hadoop2.7.tgz

run rm -rf spark-2.1.0-bin-hadoop2.7.tgz

run mv spark-2.1.0-bin-hadoop2.7/* ./

env spark_home /spark

env path /spark/bin:$path

env path /spark/sbin:$path |

3、编写master dockerfile

?

|

1

2

3

4

5

6

7

8

9

10

11

12

13 |

from ravenzz/spark-hadoop

maintainer ravenzz <raven.zhu@outlook.com>

copy master.sh /

env spark_master_port 7077

env spark_master_webui_port 8080

env spark_master_log /spark/logs

expose 8080 7077 6066

cmd ["/bin/bash","/master.sh"] |

4、编写worker dockerfile

?

|

1

2

3

4

5

6

7

8

9

10

11

12 |

from ravenzz/spark-hadoop

maintainer ravenzz <raven.zhu@outlook.com>

copy worker.sh /

env spark_worker_webui_port 8081

env spark_worker_log /spark/logs

env spark_master "spark://spark-master:32769"

expose 8081

cmd ["/bin/bash","/worker.sh"] |

5、docker-compose

?

|

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

22

23

24

25

26

27

28

29

30

31

32

33

34

35 |

version: '3'

services:

spark-master:

build:

context: ./master

dockerfile: dockerfile

ports:

- "50001:6066"

- "50002:7077" # spark_master_port

- "50003:8080" # spark_master_webui_port

expose:

- 7077

spark-worker1:

build:

context: ./worker

dockerfile: dockerfile

ports:

- "50004:8081"

links:

- spark-master

environment:

- spark_master=spark://spark-master:7077

spark-worker2:

build:

context: ./worker

dockerfile: dockerfile

ports:

- "50005:8081"

links:

- spark-master

environment:

- spark_master=spark://spark-master:7077 |

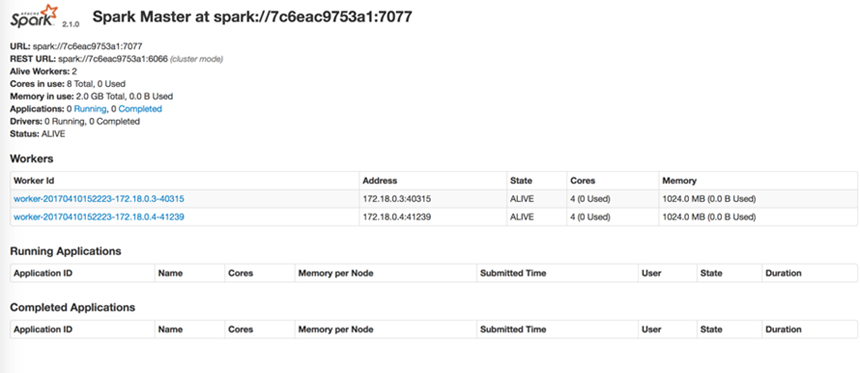

6、测试集群

?

|

1 |

docker-compose up |

访问http://localhost:50003/ 结果如图

参考链接

本例源代码

总结

以上就是这篇文章的全部内容了,希望本文的内容对大家的学习或者工作能带来一定的帮助,如果有疑问大家可以留言交流,谢谢大家对快网idc的支持。

原文链接:http://www.jianshu.com/p/4801bb7ab9e0

相关文章

猜你喜欢

- 服务器虚拟化技术深度科普 2025-05-27

- 服务器租用价格怎么计算?服务器租用多少钱一年? 2025-05-27

- 云服务器的“弹性”体现在哪些方面? 2025-05-27

- 刀片服务器是什么 刀片服务器的主要特点 2025-05-27

- 利用FTP和计划任务自动备份网站数据和数据库 2025-05-27

TA的动态

- 2025-07-10 怎样使用阿里云的安全工具进行服务器漏洞扫描和修复?

- 2025-07-10 怎样使用命令行工具优化Linux云服务器的Ping性能?

- 2025-07-10 怎样使用Xshell连接华为云服务器,实现高效远程管理?

- 2025-07-10 怎样利用云服务器D盘搭建稳定、高效的网站托管环境?

- 2025-07-10 怎样使用阿里云的安全组功能来增强服务器防火墙的安全性?

快网idc优惠网

QQ交流群

您的支持,是我们最大的动力!

热门文章

-

2025-05-27 104

-

2025-05-27 89

-

勒索软件 Akira 瞄准 VMWare 旗下软件而来:加密用户虚拟机镜像

2025-05-26 44 -

2025-05-27 100

-

2025-05-25 85

热门评论